LLM・RAGのビジネス導入の落とし穴「回答精度が期待より低い」などの回避法

2025.1.31

株式会社Laboro.AI リードマーケター 熊谷勇一

執行役員 マーケティング部長 和田 崇

概 要

LLMの利用やそれに寄せられる期待は高まり続けており、RAGのような精度を高める手法の普及も進んでいます。しかし、RAGを組み合わせたLLMのビジネス導入は簡単というわけではなく、いくつかの「落とし穴」があります。LLMやRAGの基本を踏まえた上で、その落とし穴の特徴と回避法を解説します。

目 次

・LLMが注目されるようになった背景

・LLMでできること

・自然言語処理

・コンテンツ生成

・対話システムと支援ツール

・データ分析とインサイト抽出

・LLMの精度を向上させるRAG

・RAGの仕組み

・検索フェーズ

・生成フェーズ

・RAGによる精度向上のポイント

・ハルシネーションの抑制

・柔軟な適応性

・RAG導入時のチューニングポイント

・RAG活用による効果的な応用例

・LLM・RAGの落とし穴と回避法

・落とし穴①:回答精度への思い込みを放置する

・落とし穴②:十分なデータの前処理をしない

・落とし穴③:ユーザーから得られる改善のチャンスを逃す

・落とし穴回避には外部ベンダー活用が有効

LLMが注目されるようになった背景

LLM(Large Language Models、大規模言語モデル)は、その名の通り巨大なデータセットと、ディープラーニング技術を用いて構築された言語モデルです。ここでいう「大規模」とは、従来の自然言語モデルと比べて計算量、データ量、パラメータ数が大幅に増えていることを意味しています。

大規模言語モデルは人間に近い流暢な対話が可能であり、自然言語を用いたさまざまな処理を高精度でできることから、世界中で注目を集めています。

LLMが注目されるようになった主な背景には例えば以下の五つが挙げられます。

①人間の言語能力に匹敵する性能の実現:これまでのAI技術では難しいとされていた「人間との自然な対話・応答」がLLMによって可能になり、実用が進展しています。

②技術的ブレークスルー:2017年に登場した ”Transformer” モデルにより、BERTなどの自然言語処理モデルが飛躍的に進化しました。さらに、OpenAIがGPTシリーズとして文章生成型のLLMを開発し、膨大なデータと高性能なハードウェアを組み合わせることで、文脈を踏まえた自然な言語生成が高速で実施できるようになりました。

③ビジネス価値の向上:LLMは、高い意味解釈能力により、従来の検索システムより高精度な情報収集を可能にするだけでなく、質問応答や文章生成、タスク自動化など多様な業務ニーズに応えられる汎用性を備えています。これにより、企業は意思決定のスピードアップや新規サービスの創出といった高付加価値分野にリソースを集中しやすくなり、ビジネスの生産性と競争力を大きく向上させられる可能性があります。

④多様な応用可能性:自動化の促進、カスタマーサポートの向上、情報アクセスの改善、創造性の支援など、分野を問わずに幅広く活用できることが見いだされています。

⑤性能の維持・向上の道筋が複数:「スケール則」により、パラメータ数、学習量、計算量の増加に伴ってLLMの性能も向上することが分かりました。一方で、パラメータ数はある程度に抑えつつ十分な性能は維持し、より低コストに運用するSML(Small Language Models、小規模言語モデル)も注目されています。

これらの要因により、LLMは企業のDXを加速させ、価値向上・創出をする可能性を秘めており、大きな注目を集めるようになりました。

参考:NRI「大規模言語モデル(LLM)とは」

LLMのトレンドについてはこちらもご覧ください。

LLM(大規模言語モデル)、トレンドは「小で事足りる」

LLMでできること

自然言語処理

LLMが実行できる自然言語処理関連のタスクとして以下が挙げられます。

テキスト分類:テキストを特定のカテゴリに分類(例:スパムメールの検出)。

感情分析:テキストから感情や意見を抽出。

情報抽出:特定の情報(例:人名、日付)をテキストから抽出。

文章要約:テキストの内容を簡潔に要約。

翻訳:複数の言語間の翻訳。

質問応答:特定の質問に対する回答を提供(例:FAQ)。

コンテンツ生成

自然言語生成(NLG)の分野でも多様なテキストを作成できます。

テキスト生成:小説、ブログ記事、広告コピー、ニュース記事などに加工し得るテキストを生成。

コード生成:プログラムコードの作成、最適化、バグの検出や修正提案。例えば、製造現場でニッチなプログラム言語を使い続けてきた場合、その知見がベテランスタッフに属人化してしまっていても、その知見をLLMに取り込めることもあり、次代のスタッフがそのプログラム言語を扱えるようにする際に有効です。

対話システムと支援ツール

チャットボット・質問応答システム:ユーザーの入力に応じて会話を行うシステムの構築。

業務支援:ユーザーや企業向けに効率化やタスク自動化の提案。

データ分析とインサイト抽出

市場調査・トレンド分析:SNSや商品・サービスのレビューなどのテキストを基に、消費者の意見やトレンドを把握。

業務プロセス分析:文書や業務プロセスを解析し、効率化の提案。

LLMの精度を向上させるRAG

RAG(Retrieval-Augmented Generation)は、LLM に外部知識を組み合わせることで、より詳しく正確な応答の生成を目指す手法です。LLM単体では、学習に使用したデータの範囲でしか回答を生成できません。そのため、学習後に更新された最新情報や、企業内部の非公開情報は参照できず、回答の正確性に限界があります。外部知識を活用するRAGによりその問題が解決できます。

RAGの仕組み

まずユーザからの質問に対して最も関連性の高い外部データを検索し(検索フェーズ)、その後、検索結果を基に質問に対する自然な言語での応答を生成する(生成フェーズ)という2段階のプロセスを経ます。これにより、大規模なドキュメントコーパスから適切な情報を効率的に抽出できます。

検索フェーズ

ユーザーが入力した質問に基づき、LLMに組み合わせた外部データベースや社内文書などから関連情報を検索します。質問の文脈やキーワードを解析し、最適な情報を取得します。これにより、LLM単体では得られない最新情報や専門知識を補完します。

生成フェーズ

検索フェーズで得られた関連情報を基に、LLMが回答を生成します。ユーザーの質問内容と検索結果をプロンプトとしてLLMに入力し、それに基づいて自然言語処理による回答が生成されます。最終的に生成された回答は、検索結果との整合性が取れているため、より正確で信頼性の高いものとなります。

RAGによる精度向上のポイント

ハルシネーションの抑制

LLMでは時に、嘘の情報をあたかも正しいかのように回答してしまうハルシネーションという現象が起きることがありますが、RAGを活用すると検索フェーズでより正確な情報が得られて回答の生成に生かせるため、ハルシネーション発生リスクが軽減されます。

柔軟な適応性

特定分野や業界固有のデータベースを利用することで、専門的な質問にも対応可能です。また、新しいデータを継続的に取り込むことで、システムを最新の状態を維持できます。

RAG導入時のチューニングポイント

RAGの精度向上には以下の方法があります。

データ構造化:データベース内の文書をチャンク単位で分割し、メタデータやナレッジグラフを付加することで検索精度を向上させられます。

ベクトル検索:質問文や文書内容をベクトル化し、高度な類似度計算アルゴリズムで関連性の高い情報を抽出します。

再ランク付け:検索結果から最も関連性の高い情報を選別するプロセスで、精度をさらに高めます。

プロンプトエンジニアリング:LLMへのプロンプトを最適化し、期待する回答品質を引き出します。

RAG活用による効果的な応用例

カスタマーサポート:顧客から寄せられる多様な質問に対し、自社データベースをLLMと組み合わせてより正確な回答を提供し、顧客満足度と対応効率の向上を狙えます。

専門分野での知識提供:医療や法律など、高度な専門知識が必要な場面でも、信頼性の高い外部データをLLMと組み合わせて、より正確な回答を得られるようにすることが狙えます。

LLM・RAGの落とし穴と回避法

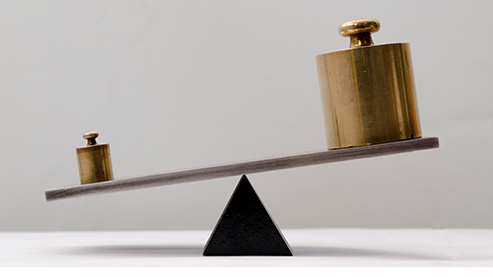

以上のように、LLMはRAGと組み合わせれば精度を高められることから、導入も簡単に思えるかもしれません。しかしそこには意外な難しさがあります。なぜなら、RAGには以下の三つの落とし穴があるからです。

落とし穴①:回答精度への思い込みを放置する

開発チームとしては、LLM・RAGを使ったシステムの回答精度を、例えば「80%程度」などのように、ある程度の誤りも含めて見積もることが多いでしょう。しかし、LLMやAIの技術に明るくない現場のユーザーや決済者が、精度に過度の期待をしてしまうことや、メディアなどの情報から「当たり障りのない回答しかしてくれなかったり、ハルシネーションが起きたりする」と思い込んでいるために、実用的には問題にならない程度の誤りに対して過敏に否定的な反応をしてしまうことがあります。このように開発チームと現場のユーザーや決済者で、精度に対する判断基準が大きくずれてしまいがちです。

こうしたギャップを解消するために、例えば、現場のユーザーと開発チームの間で期待値をすり合わせながら導入を進めるアジャイル開発を採用する方法があります。その際、適切なタイミングで開発内容や進捗を関係者に伝える確認会を開催するのも有効でしょう。さらに、生成AIを含むDX関連の情報を取り上げる勉強会も、知識を底上げして齟齬を生まないために開催する意義があります。

落とし穴②:十分なデータの前処理をしない

LLM・RAG導入が簡単ではない理由には、回答精度が落ちる原因が前出の検索フェーズと生成フェーズの2カ所にあることもあります。生成フェーズは、使用するLLMのモデル自体の変更とプロンプト改良などでチューニングすることが知られていますが、検索フェーズにも改良の余地があります。

検索フェーズでの精度が落ちる原因としては「関連性の低い情報の取得」や「必要な情報の不足」が考えられます。その具体的な要因の一つとして、引用するデータがRAGに適したデータ構造になっていないことがあります。逆にいえば、データの前処理をすることが検索精度の向上の鍵を握ります。

データの前処理はユーザー自身でもできますが、単純ではありません。まず、例えばExcelファイルから正しい順番でテキストを抽出するといった、「データの整備」をしなければなりません。次に、「データクレンジング」や「データクリーニング」と呼ばれる作業が必要です。例えば、文字を主体としたデータのクレンジングには、「不要な文字や記号の削除」「空白や改行の調整・削除」「誤記や脱字の修正」「全角・半角や大文字・小文字の統一」「表記ゆらぎの統一」「重複データの削除」などがあります。さらに、ドキュメントに図や画像、動画、音声といったテキスト以外のデータ含まれている場合もあり、そうした場合には画像や動画などを事前にテキスト化する必要があります。

参考:日経クロステック「「RAGはすごい」とのユーザーの期待が落とし穴、検索精度はデータの分け方で向上」

落とし穴③:ユーザーから得られる改善のチャンスを逃す

RAGを改善する方法としては、意外に思えるかもしれませんが、RAGを活用したLLMアプリケーションのユーザーインターフェース(UI)の改良も挙げられます。RAG活用のLLMの良し悪しは、最終的にはユーザーが納得感を得て使えるかどうかで決まる面があります。その際、回答の精度ももちろん納得感に影響しますが、直接見て操作するUIも重要です。

例えば、十分な回答をするには情報が足りない場合に、追加の情報を入れてもらうようにユーザーに聞き返す、「こんなことを聞きたいのではないか」という質問候補をレコメンドする、といったことをUIに組み込み、ユーザーの納得感を高め、「いいツールだから使い続けよう」と思ってもらうことです。

これが実現すると、システムとユーザーの対話のデータが蓄積し、さらには「いいねボタン」の設置などの上でフィードバックを得やすくなり、開発側だけでは気付きづらい改善点が見つかりやすくなります。

参考:日経クロステック「実運用では細かい工夫が不可欠なRAG、導入後にも継続的な改良やユーザー教育」

落とし穴回避には外部ベンダー活用が有効

以上、LLMの落とし穴とその回避方法を示しましたが、自社でこれらをすべて実施するのは、まずそうした人材を育成または採用することから始める必要もあり、簡単ではないでしょう。そこでAIベンダーを活用するのも有効な手段です。

その際、単にLLM・RAGのシステムを開発・運用できるだけのベンダーではなく、LLM・RAGを手段としてビジネスにおいて本当に成し遂げるべきことから議論でき、その結果を実現できるベンダーが理想でしょう。前述のデータの前処理はAIベンダーを名乗るところであればいずれも得意とするところかもしれません。しかし、こちらもまた前述の、現場のユーザーと開発チームの間での期待値のギャップを解消できたり、ユーザーの納得感を高めつつシステムを改善できたりすることに、ビジネス成果もきちんと見据えることは深い関係があることは想像に難くなく、ビジネスとAIの両方をよく分かったベンダーは限られるでしょう。

Laboro.AIでは、「LLMなどAIをビジネスにどう活用すべきか」「活用する方法はいったん設定したけれども、外部の知見も生かして再設定し、ビジネスインパクトを高めたい」といった課題を解決するコンサルティングサービスを提供しており、ビジネス成果を導き出します。

これまでお客様から「なんとなく考えていた構想を形にしてくれて、プロジェクトの成功を怪しんでいた人も巻き込んで実現することができた」「開発初期のLLMの出力の精度の目安を示してくれて、周りを納得させながらプロジェクトを進められた」といったお声をいただいており、目標設定からビジネス成果を出すまでの伴走型のコンサルティングサービスを提供している強みを発揮しています。ぜひ一度ご相談ください。

執筆者

マーケティング部 リードマーケター 熊谷勇一

中央大学文学部卒業、北陸先端科学技術大学院大学情報科学研究科博士前期課程修了。日本経済新聞社など日経ブランド企業で16年、雑誌、書籍、ウェブサイト、動画などの編集・執筆を手掛けた後、2022年からLaboro.AIに参画。

執行役員 マーケティング部長 和田 崇

立教大学大学院経営学修士(マーケティング論・消費者行動論)。立教大学大学院ビジネスデザイン研究科博士後期課程中退。KDDI株式会社に入社、コンシューマ向け商品・サービスのクロスメディアによるプロモーション施策の立案・企画運営に携わったのち、全国漁業協同組合連合会を経て、2019年にLaboro.AIに参画。マーケティング/ブランディング業務に従事する傍ら、NewsPicksプロピッカーとして活動するほか、日経クロストレンドなどメディア寄稿多数。